Quantum computing is ready to displace classical AI infrastructure/La computación cuántica lista para desplazar la infraestructura clásica de IA

Source

We are all aware of the rapid development of artificial intelligence, which is why AI is facing a fundamental bottleneck with traditional hardware. It's not that current chips (GPUs like NVIDIA's H100) are bad; they are incredibly good. The problem is that AI's ambition has outpaced Moore's Law, and current hardware can't keep up with feeding the machine. A recent analysis by Northland Capital Markets points to a significant paradigm shift: quantum computing is destined to replace the current classical infrastructure for training AI models, especially large-scale ones like LLMs.

Todos somos conscientes del vertiginoso desarrollo de la inteligencia artificial, por ello la IA está enfrentando un cuello de botella fundamental con el hardware clásico. No es que los chips actuales (GPUs como las H100 de NVIDIA) sean malos, son increíblemente buenos. El problema es que la ambición de la IA ha superado la capacidad de la ley de Moore y no dan abasto a alimentar al monstruo. En un reciente análisis de Northland Capital Markets se apunta a un cambio de paradigma significativo: la computación cuántica está destinada a reemplazar la infraestructura clásica actual para entrenar modelos de IA, especialmente los de gran tamaño como los LLM.

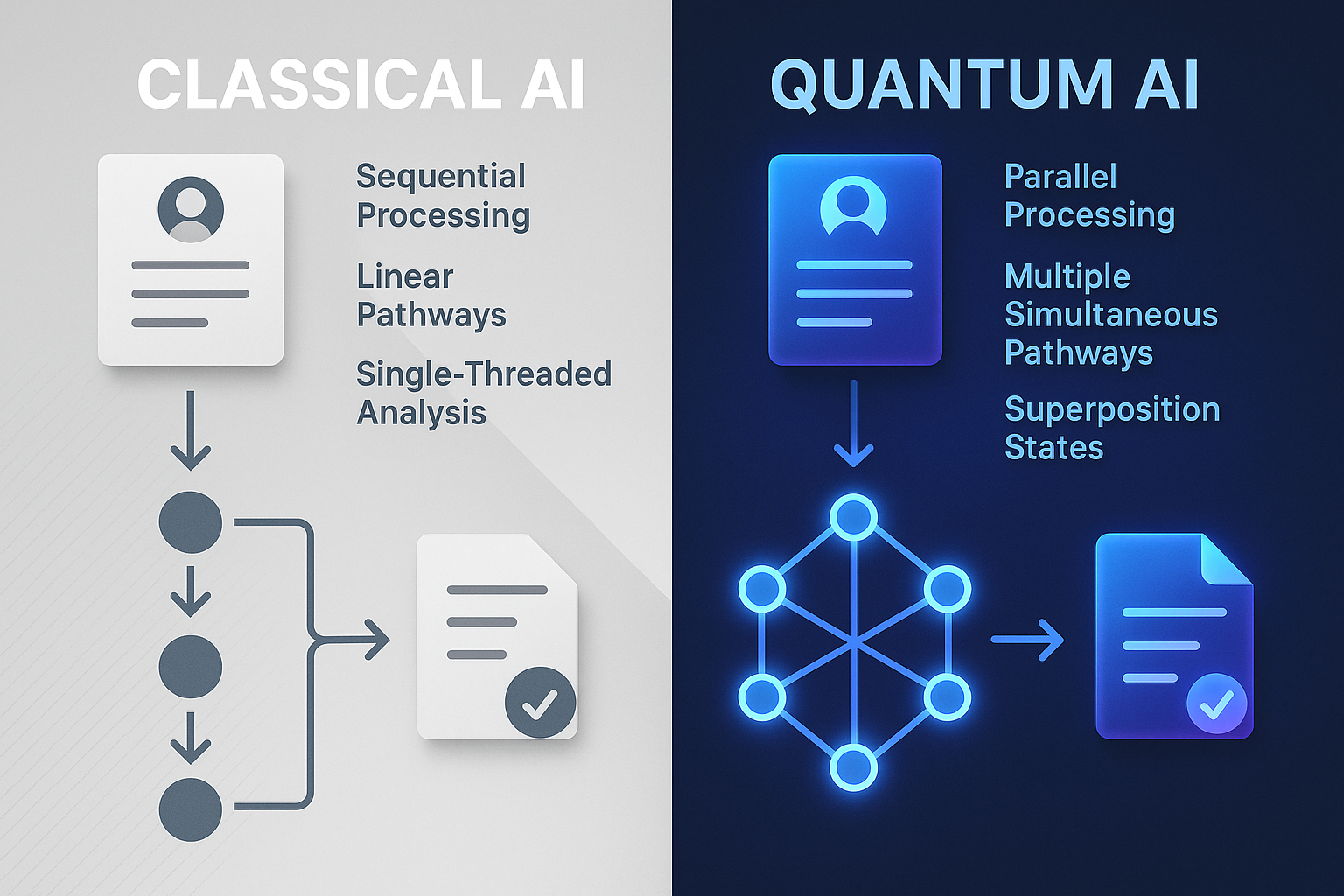

The analysis indicates that training for Large Language Models (LLMs) takes place in a 4096-dimensional space. This makes the process a massively parallel optimization problem. In other words, current GPUs are reaching a physical limit in efficiently handling this complexity. The quantum proposal suggests that quantum systems are the primary way forward for managing these workloads. While a classical computer tests possibilities one after another, a quantum computer can evaluate multiple possibilities simultaneously thanks to quantum superposition, dramatically accelerating the optimization process.

El análisis señala que el entrenamiento de los Grandes Modelos de Lenguaje (LLM) se realiza en un "espacio de 4096 dimensiones". Esto convierte el proceso en un problema de optimización masivamente paralelo. En otras palabras, los chips actuales (GPUs) están llegando a un límite físico para manejar esta complejidad de manera eficiente. La propuesta cuántica sugiere que los sistemas cuánticos son "el camino principal" para gestionar estas cargas de trabajo. Mientras que un ordenador clásico prueba posibilidades una tras otra, un ordenador cuántico puede evaluar múltiples posibilidades a la vez gracias a la superposición cuántica, acelerando drásticamente el proceso de optimización.

Source

To try and explain this, let's use an analogy. Imagine that AI wants to find the best route between Madrid and Tokyo, but it has to test EVERY possible combination of streets, highways, turns, and shortcuts. The current hardware is a Bugatti, the fastest car in the world, but it still has to travel every road, one by one. To test all the routes, you would need thousands of Bugattis guzzling gasoline like crazy for years. The bottleneck occurs because you can't build more Bugattis because you run out of gasoline (energy) and garage space (memory).

Para intentar explicarlo vamos a hacer una analogía. Imaginemos que la IA quiere encontrar la mejor ruta entre Madrid y Tokio, pero tiene que probar TODAS las combinaciones de calles, autopistas, giros y atajos posibles. El hardware actual es un Bugatti, el coche más rápido del mundo, pero sigue teniendo que recorrer cada carretera, una por una. Para probar todas las rutas, se necesitaría miles de Bugatti consumiendo gasolina como locos durante años. El cuello de botella se forma porque no puedes construir más Bugatti porque se acaba la gasolina (energía) y el espacio en el garaje (memoria).

The quantum hardware proposed in the study would be a quantum teleporter capable of instantly evaluating all possible routes from Madrid to Tokyo simultaneously, without needing fuel or a garage. If this prediction comes true, the impact would be transformative in several key areas of artificial intelligence. With quantum computing, training a model that currently takes months and costs hundreds of millions of dollars could be reduced to weeks or days, allowing for much faster iteration and experimentation.

El hardware cuántico propuesto en el estudio sería un teletransportador cuñantico que podría evaluar todas las rutas posibles de Madrid a Tokio instantáneamente y a la vez, sin necesitar gasolina ni garaje. Si esta predicción se cumple, el impacto sería transformador en varias áreas clave de la inteligencia artificial. Con la computación cuántica, entrenar un modelo que hoy tarda meses y cuesta cientos de millones de dólares podría reducirse a semanas o días, permitiendo iterar y experimentar mucho más rápido.

Source

Current AI excels at pattern recognition, but struggles with problems in quantum physics, new materials, or complex molecules. Quantum computing would allow the creation of hybrid systems: the quantum component to simulate physical reality and the classical/AI component to interpret that data. This would revolutionize medicine and drug development, materials science, and climatology. The impact would be disruptive; it's not just about doing the same things faster, but about being able to do things that are currently impossible to calculate.

La IA actual es excelente reconociendo patrones, pero tiene dificultades con problemas de física cuántica, nuevos materiales o moléculas complejas. La computación cuántica permitiría crear sistemas híbridos: la parte cuántica para simular la realidad física y la parte clásica/IA para interpretar esos datos. Esto revolucionaría la medicina y el diseño de nuevos fármacos, la ciencia de materiales o la climatología. El impacto sería disruptivo, no se trata solo de hacer lo mismo más rápido, sino de poder hacer cosas que ahora son imposibles de calcular.

According to researchers, for now it only works in laboratories and in the cloud, but the large technology companies that train large artificial intelligence models estimate that the first useful small-scale systems will begin to arrive between 2027 and 2029. Therefore, we will have to wait until the 2030s for quantum infrastructure to clearly begin to "displace" classic GPU data centers for the heaviest training tasks. But time flies.

Según los investigadores por el momento solo funciona en laboratorios y en la nube, pero las grandes empresas tecnológicas que entrenan los grandes modelos de inteligencia artificial, estiman que los primeros sistemas útiles a pequeña escala empezarán a llegar entre 2027 y 2029. Por lo que habrá que esperar hasta la década de 2030 para que la infraestructura cuántica comience claramente a "desplazar" a los centros de datos clásicos de GPUs para las tareas más pesadas de entrenamiento. Pero el tiempo pasa volando.

More information/Más información

https://www.investing.com/news/stock-market-news/quantum-computing-poised-to-displace-classical-ai-infrastructure-northland-says-4630212